http://en.wikipedia.org/wiki/Information_entropy

Iz ovog teksta se vidi da Senonova entropija ima veze sa informatikom (kodovanjem). Te bi bilo lepo ako bi neko to mogao da mi pojasni od informaticara npr.

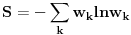

Statisticka entropija se u kvantnoj statistici definise kao

uz uslove da su

nenegativne i da je

nenegativne i da je  .

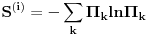

.Informaciona entropija se definise kao

gde su

verovatnoce za odigravanje dogadjaja iz nekog konacnog skupa

verovatnoce za odigravanje dogadjaja iz nekog konacnog skupa

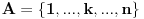

Pa ako su svi dogadjaji iz skupa

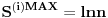

podjednako verovatni sistem je maksimalno neuredjen, a samim tim je informaciona entropija, gore definisana, maksimalna. I trivijalno sledi

podjednako verovatni sistem je maksimalno neuredjen, a samim tim je informaciona entropija, gore definisana, maksimalna. I trivijalno sledi

Iz maksimalnosti entropije se izvode kvantno- statisticki ansambli. Prva varijacija nula, druga veca od nule. (varijacija se koristi jer kod ansambala zamrznemo vreme i posmatramo mozaik) Mene zanima vise o ovoj vezi. I kolko je informaciona entropija bitna za statisticku fiziku.

Informaciona entropija - Senon i njena veza sa statistickom entropijom

Informaciona entropija - Senon i njena veza sa statistickom entropijom